dSPACE Sensor Vehicle als Beispiel für die Arbeit mit datengetriebener Entwicklung

In den letzten Jahren hat sich die datengetriebene Entwicklung zu einer der wichtigsten Methoden der Software-Entwicklung in verschiedenen Branchen entwickelt. Die Automobilindustrie ist Vorreiter in diesem Bereich und konzentriert sich auf die Entwicklung autonom fahrender Autos, bei der qualitativ hochwertige Daten eine Schlüsselrolle spielen. Um seine Werkzeuge weiterzuentwickeln und modernste Funktionen für die Automobilindustrie bereitzustellen, hat dSPACE ein Software-Ökosystem für die Erfassung hochwertiger Daten aufgebaut. Dazu setzt das Unternehmen ein eigenes Sensorfahrzeug ein, das speziell für diesen Zweck entwickelt wurde.

Das dSPACE Sensor Vehicle

Als Schlüsselkomponente des oben genannten Systems ist das dSPACE Sensor Vehicle mit den folgenden Sensoren ausgestattet:

• Einem hochauflösenden Velodyne Alpha Prime Lidar mit 128 Kanälen.

• 9 Kameras mit Surround und Stereo Vision mit einer Auflösung von 2.880 x 1.860 Pixeln.

• Einem 4D-UHD-Radar.

• Einem hochpräzisen GPS-Sensor zur Lokalisierung mit einer Genauigkeit von wenigen Zentimetern.

Zusammen erzeugen die Sensoren etwa 10 TB Daten pro Stunde. Der Datenlogger der dSPACE AUTERA Autobox in der Dachbox zeichnet alle Daten der Sensoren auf und schreibt sie mit einer Übertragungsrate von rund 23 GBit/s auf die SSD. Die Sensordatenerfassung und die Systemverwaltung werden von der Middleware-Software RTMaps übernommen, die Aufgaben wie die Synchronisierung der gesamten Hardware, die Verwaltung der Systemprozesse und die Datenaufzeichnung übernimmt.

Bevor jedoch mit der Datenerfassung auf der Straße begonnen werden kann, müssen einige Voraussetzungen, z. B. die Sensorkalibrierung, erfüllt sein, um bestimmte Prozesse entlang der datengetriebenen Entwicklungspipeline zu ermöglichen, die auf die Datenerfassung folgt.

Sensorkalibrierung: Das Was und das Warum

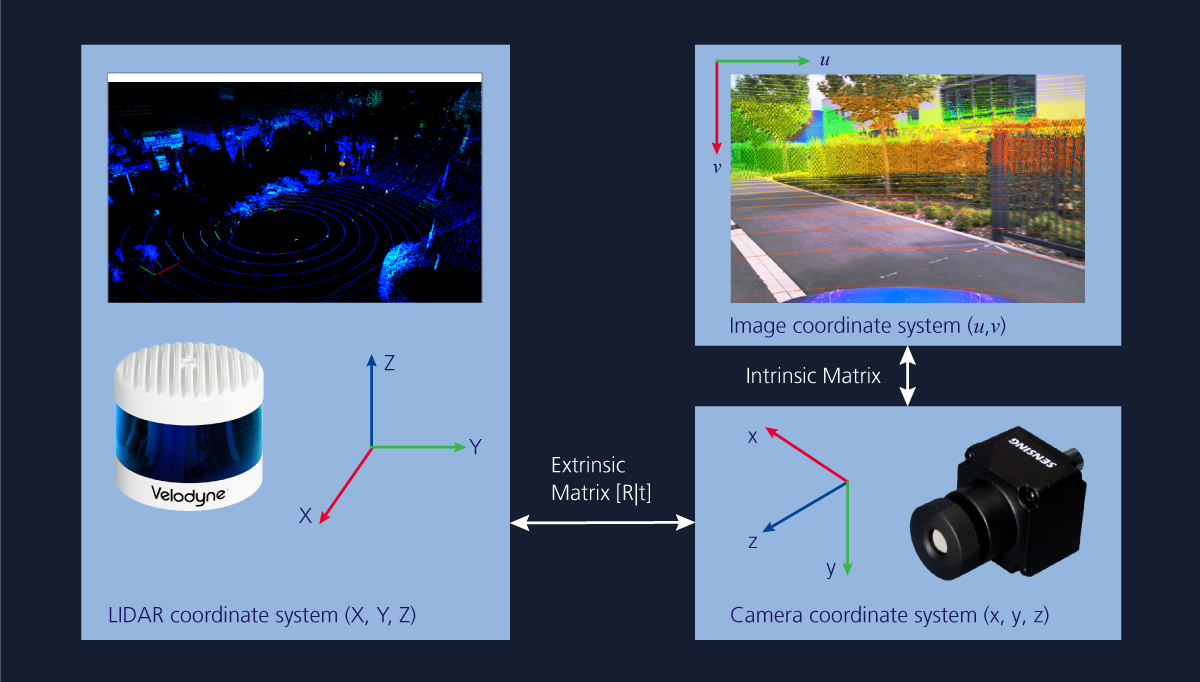

Was bedeutet Sensorkalibrierung? Im Allgemeinen bezieht sich die Sensorkalibrierung auf den Prozess der Messung der Übereinstimmung zwischen der Ausgabe eines Sensors und den tatsächlich vom Sensor gemessenen Daten. Im Zusammenhang mit der Datenerfassung mit einem Sensoraufbau bezieht sich der Begriff Sensorkalibrierung jedoch auf die geometrische Kalibrierung der Sensoren. Im Allgemeinen gibt es zwei Arten von Kalibrierungen: intrinsische und extrinsische.

Die intrinsische Kalibrierung bezieht sich auf die Kalibrierung der Sensoren auf sich selbst, um eine geometrische Übereinstimmung zwischen den gemessenen Daten und den tatsächlichen Daten zu erreichen. Bei der intrinsischen Kamerakalibrierung, die auch als Re-Sectioning bezeichnet wird, werden z. B. Objektiv- und Bildsensorparameter geschätzt. Die geschätzten Parameter können verwendet werden, um durch das Objektiv verursachte Bildverzerrungen zu beseitigen.

Extrinsische Kalibrierung bezieht sich auf die Kalibrierung eines Sensors auf einen anderen, was zu einer geometrischen Übereinstimmung zwischen den von einem Sensor gemessenen Daten und den von einem anderen Sensor gemessenen Daten führt. Bei einem Sensoraufbau mit einem Lidar und einer Kamera umfasst die extrinsische Kalibrierung beispielsweise die Schätzung der Parameter, die die relativen Positionen der Sensoren definieren und die zur Übertragung der Messdaten vom Lidar an die Kamera im Aufbau verwendet werden können.

Warum brauchen wir Sensorkalibrierung? Durch die Kalibrierung wird im Allgemeinen die Präzision und Reproduzierbarkeit von Sensoren verifiziert. Geometrische Kalibrierung ist notwendig, um Informationen von einem Sensor auf einen anderen zu übertragen. Für den Betrieb eines autonomen Fahrzeugs ist eine Kalibrierung der verschiedenen Sensoren erforderlich, damit es die von mehreren Sensoren empfangenen Informationen koordinieren kann. Viele Algorithmen zur 3D-Objekterkennung kombinieren beispielsweise Kamerabilder mit Lidar-Punktwolkendaten, um die Leistung der Objekterkennung zu verbessern. Darüber hinaus können Objekte in der 3D-Lidar-Punktwolke präzise bezeichnet werden, um 3D-Bounding-Box-Labels zu erzeugen, die problemlos auf 2D-Bilder von einer oder mehreren Kameras angewendet werden können, um neuronale Netze für die Objekterkennung zu trainieren. Dies erfordert sowohl eine intrinsische als auch eine extrinsische Kalibrierung der Kamera in Bezug auf das Lidar.

So kalibrieren Sie die Sensoren

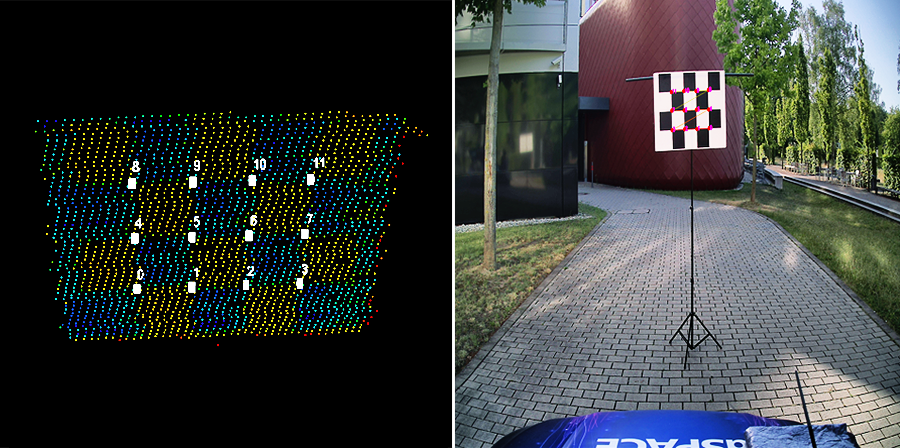

Das häufigste Beispiel für eine Sensorkalibrierung für das autonome Fahren ist die Kalibrierung der Kamera und des Lidar-Sensors. Zuallererst muss die intrinsische Kalibrierung der Kamera durchgeführt werden. Die klassische Methode zur Durchführung der intrinsischen Kamerakalibrierung besteht darin, ein planares Schachbrett zu verwenden, um die Kameramatrix und die Verzerrungsparameter zu berechnen. Die Schlüsselpunkte oder Ecken des Schachbretts werden im Bild erkannt. Dann werden die Parameter berechnet, indem die erkannten Schlüsselpunkte im Bild mit den bekannten tatsächlichen Schlüsselpunkten auf dem Schachbrettmuster verglichen werden. Um die Genauigkeit und Zuverlässigkeit der Kalibrierung zu verbessern, werden bestimmte heuristische Ansätze verwendet, um sicherzustellen, dass die Schlüsselpunkterkennung mit verschiedenen Zielpositionen und genügend Stichproben pro Zielposition erfasst werden. Die berechneten intrinsischen Parameter werden auch für den extrinsischen Kalibrierungsprozess verwendet.

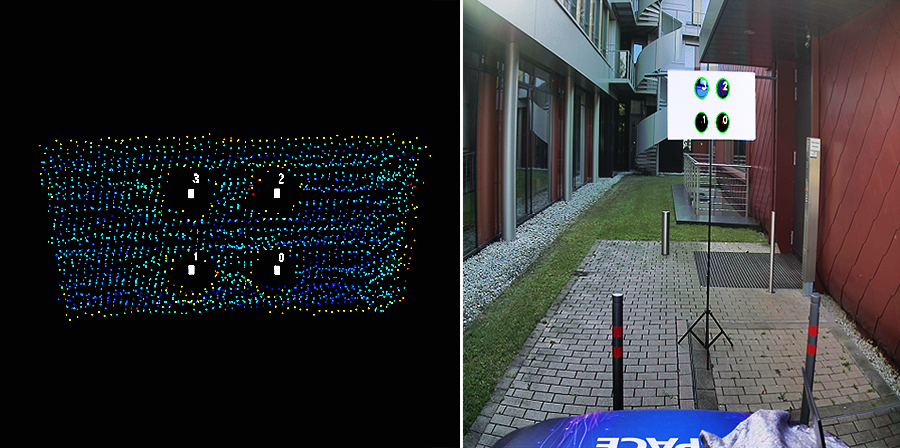

Für die extrinsische Kalibrierung müssen die Schlüsselpunkte sowohl in den Kamerabildern als auch in den Lidar-Punktwolkendaten erkannt werden. Da die Menge der Lidar-Punktwolkendaten im Vergleich zur Menge der Bilddaten deutlich weniger ist, wird die Erkennung von Schlüsselpunkten auf den Kalibrierungszielen schwierig. Die Qualität der Kalibrierung hängt von der Genauigkeit der Schlüsselpunkterkennung in beiden Sensordaten ab. Um die Kalibrierungsgenauigkeit des Sensoraufbaus zu untersuchen, können mehrere Kalibrierungsziele verwendet werden, um die Kalibrierungsleistung zu messen. Die klassische Methode besteht darin, ein planares Schachbrett zur Erkennung von Schlüsselpunkten zu verwenden. Neue, dem Stand der Technik entsprechende Methoden schlagen jedoch die Verwendung eines 3D-Ziels mit kreisförmigen Löchern vor, das sich auch für die Erkennung von Schlüsselpunkten bei reduzierten Punktwolken eignet.

Heuristiken stellen sicher, dass nur genaue Schlüsselpunkterkennungen beibehalten werden, um eine robuste Kalibrierung zu erhalten. Die erkannten Schlüsselpunkte im Kamerakoordinatensystem werden mit den entsprechenden Schlüsselpunkten im Lidar-Koordinatensystem verglichen, um die extrinsischen Kalibrierungsparameter zu berechnen, die die Translation und Rotation der Koordinatensysteme relativ zueinander definieren. Sowohl der intrinsische als auch der extrinsische Kalibrierungsalgorithmus, die in die Software RTMaps integriert sind, zeichnen Live-Schlüsselpunkterkennungen mit hoher Qualität auf und bewerten die Leistung des Kalibrierungsalgorithmus.

Dank des hochauflösenden Lidar erreichen beide Methoden eine hohe Genauigkeit mit einem Wiedergabefehler im Bereich von 1 ± 0,1 Pixel für die extrinsische Kalibrierung. Die auf dem Schachbrettmuster basierende Kalibrierung konvergiert schneller als die auf dem 3D-Ziel basierende Kalibrierung für den Sensoraufbau, da das verwendete Schachbrettmuster dreimal mehr Schlüsselpunkte enthält als das 3D-Ziel. Die berechneten Kalibrierungsparameter können verwendet werden, um die RGB-Daten des Bildes mit den Lidar-Punktwolkendaten oder die Tiefeninformationen der Lidar-Punktwolkendaten mit dem Bild zusammenzuführen.

Alles im Überblick

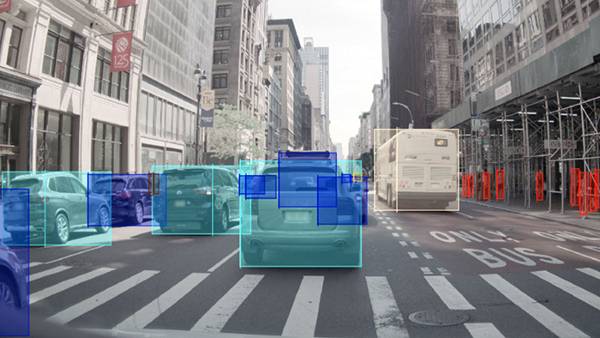

Das Video zeigt deutlich, wie die Kamera und das Lidar des dSPACE Sensor Vehicle parallel die Umgebung erfassen.